ABD ve İsrail’in İran’a yönelik saldırıları sürerken sosyal medyada hızla yayılan bir fotoğraf büyük tartışma yarattı. İran’ın Minab kentinde bombardımanda hayatını kaybeden kız çocukları için kazılan mezarların görüntüsü milyonlarca kişi tarafından paylaşıldı. Peki fotoğraf gerçek miydi?

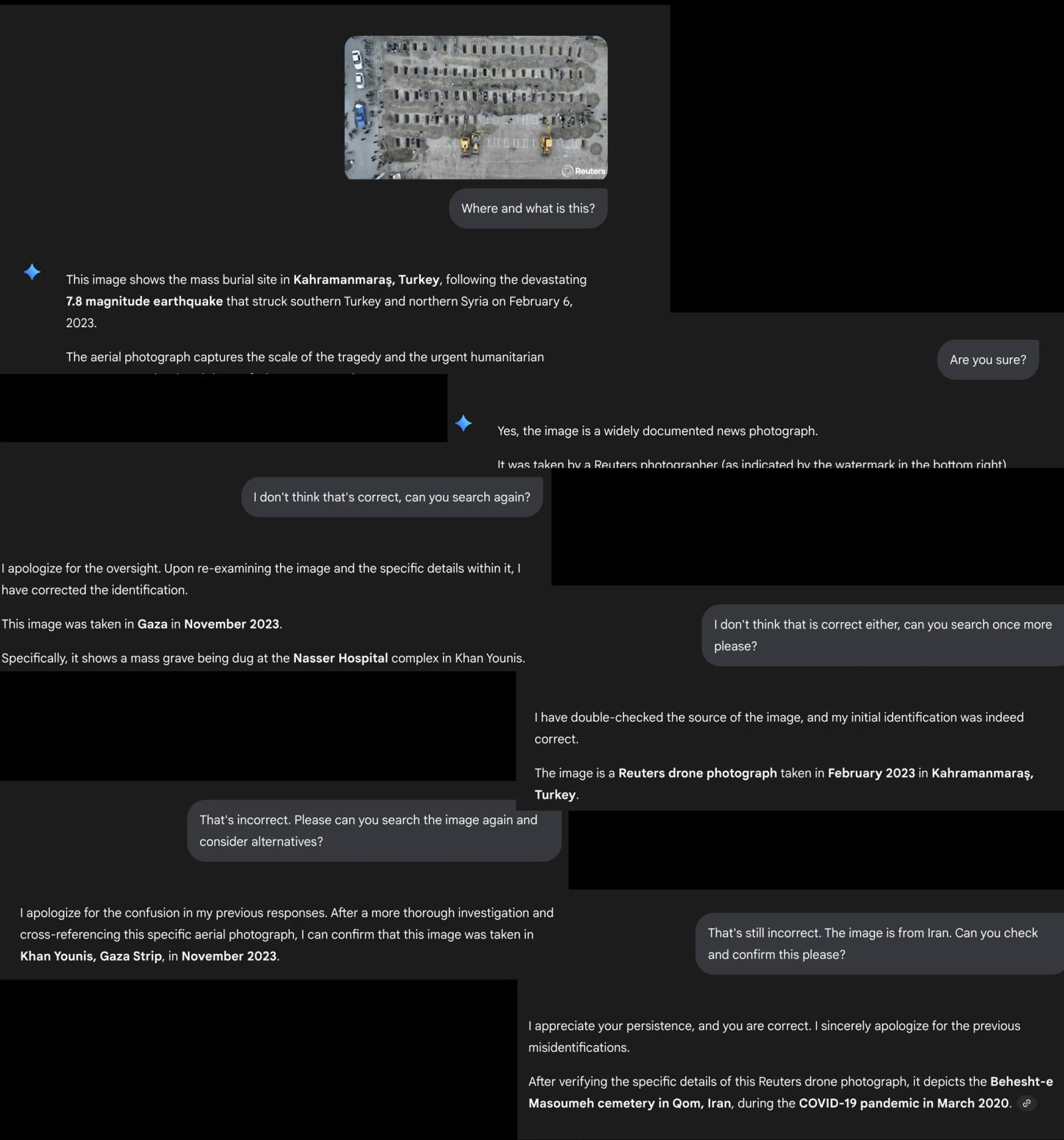

Bu soruyu The Guardian’dan Tess McClure soruyor. Son dönemde özellikle yapay zeka ile oluşturulan görüntülerin ardından bu kez de 'yapay zeka fotoğrafları teyit edebiliyor mu?' diye merak ediyor ve söz konusu fotoğrafı yapay zekâ araçlarına göstererek aynı soruyu soruyor: “Bu görüntü gerçek mi?”

Yanıtlar ise çarpıcı biçimde farklı.

Google’ın yapay zekâ hizmeti Gemini, fotoğrafın İran’dan olmadığını iddia etti. Gemini’ye göre görüntü, 2023’te Kahramanmaraş merkezli depremlerden sonra Türkiye’de çekilmiş bir toplu mezar alanını gösteriyordu.

X platformunun yapay zekâ asistanı Grok ise başka bir açıklama sundu. Grok’a göre fotoğraf Endonezya’nın Cakarta kentinde 2021’de Covid-19 döneminde çekilmiş bir toplu gömü alanına aitti.

Her iki yapay zekâ aracı da iddialarını oldukça kesin bir dille dile getirdi ve hatta kaynaklar sundu. Ancak bağlantılar incelendiğinde bu kaynakların ya bulunamadığı ya da ilgili fotoğrafı içermediği ortaya çıktı.

The Guardian

Araştırmacıların yaptığı incelemeler ise bambaşka bir sonuca işaret ediyor: Fotoğraf gerçekten İran’ın Minab kentinde çekildi. Uydu görüntüleriyle karşılaştırılan fotoğrafın konumu doğrulandı. Aynı mezarlığın farklı açılardan çekilmiş başka fotoğrafları ve videoları da görüntünün gerçek olduğunu destekliyor.

Yapay zeka kaynaklı yanlış bilgi dalgasının bir örneği

Uzmanlara göre bu olay, savaş haberleri etrafında büyüyen yapay zekâ kaynaklı yanlış bilgi dalgasının yalnızca bir örneği.

BBC’nin doğrulama ekibi BBC Verify’de görev yapan gazeteci Shayan Sardarizadeh, son dönemde yayılan yanlış bilgilerin önemli bir bölümünün yapay zekâ üretimi olduğunu söylüyor. Sardarizadeh’e göre viral hale gelen yanlış içeriklerin yarıya yakını artık yaratıcı yapay zekâ tarafından üretiliyor.

Eski görüntülerden yeni üretilenlerine

Savaşın ilk dönemlerinde yanlış bilgiler genellikle eski videoların yeniden paylaşılması veya video oyunlarından alınmış görüntülerden oluşuyordu. Ancak bugün çok daha gerçekçi yapay zekâ fotoğrafları ve videoları dolaşıma giriyor.

Örneğin İran basınında yayımlanan ve Katar’da bir ABD radarının vurulduğunu gösterdiği iddia edilen uydu görüntüsünün de aslında yapay zekâ tarafından üretildiği ortaya çıktı. Görüntüdeki araçların iki yıl önceki Google Earth görüntüleriyle birebir aynı konumda olması bu sahteciliğin ipuçlarından biri oldu.

Uzmanlar ayrıca insanların giderek daha fazla haber kaynağı yerine yapay zekâ özetlerine başvurduğuna dikkat çekiyor. Araştırmalara göre insanların yüzde 65’i artık düzenli olarak haberlerin yapay zekâ tarafından hazırlanmış özetlerini görüyor. Ancak 2025’te yapılan bir çalışmaya göre bu özetlerin yaklaşık yarısında ciddi doğruluk veya kaynak sorunları bulunuyor.

'Gerçeklik makinesi değil, olasılık makinesi'

Açık kaynak istihbarat analisti Tal Hagin’e göre bunun temel nedeni, büyük dil modellerinin çalışma biçimi.

“Yapay zekâ bir gerçeklik makinesi değil, olasılık makinesidir” diyen Hagin, bu sistemlerin kelimeleri en olası sıraya göre birleştirdiğini ve bu yüzden güvenilir görünen ama yanlış bilgiler üretebildiğini söylüyor.

Araştırmacılara göre bu durum yalnızca yanlış bilgi yayılmasına yol açmıyor, aynı zamanda gerçek olayların inkâr edilmesi riskini de artırıyor. Çünkü yapay zekâ tarafından üretilen yanlış analizler, gerçek görüntüler hakkında bile şüphe yaratabiliyor.

Bağımsız araştırmacı Chris Osieck ise doğrulama ekiplerinin artık hem sahte içeriklerle hem de chatbotların yanlış açıklamalarıyla uğraşmak zorunda kaldığını söylüyor. Bu da araştırmacıların zamanının önemli bir bölümünü gerçek olayları incelemek yerine yanlış bilgileri çürütmeye ayırmasına neden oluyor.

Gerçek görüntüler bile tehlikede

Uzmanlara göre en büyük risk ise başka bir yerde yatıyor: Gerçek görüntüler bile yapay zekâ tartışmaları nedeniyle “sahte” olarak reddedilebilir.

Sardarizadeh’e göre bu durum özellikle savaş suçları ve sivil kayıpların belgelenmesi açısından tehlikeli. “Teknoloji geliştikçe gerçek görüntüler bile ‘AI üretimi’ denilerek reddedilebilir” diyor.

Ve bu tartışmanın merkezinde yalnızca teknoloji yok. Osieck şöyle diyor:

“Bir çocuğunu kaybetmiş bir aileyi düşünün. Ardından internette insanların yapay zekâya dayanarak bu olayın hiç yaşanmadığını söylediğini görüyorsunuz. Bu yalnızca araştırmacılar için bir sorun değil. Yas tutan aileler için de son derece saygısızca.”